我校蒙古文智能信息处理技术国家地方联合工程研究中心4篇论文被ACL 2025录用,其中2篇主会、2篇findings,分别聚焦知识图谱表示学习、多模态虚假新闻检测、大语言模型偏见消除、共情对话语音合成,4篇论文第一作者分别是内蒙古大学计算机学院(软件学院)、人工智能学院李江(博士生)、胡树国(硕士生)、兰天(硕士生)、胡一帆(博士生)。ACL(Annual Meeting of the Association for Computational Linguistics)是人工智能自然语言处理(Natural Language Processing,NLP)领域最权威的国际会议之一,是CCF A类会议。

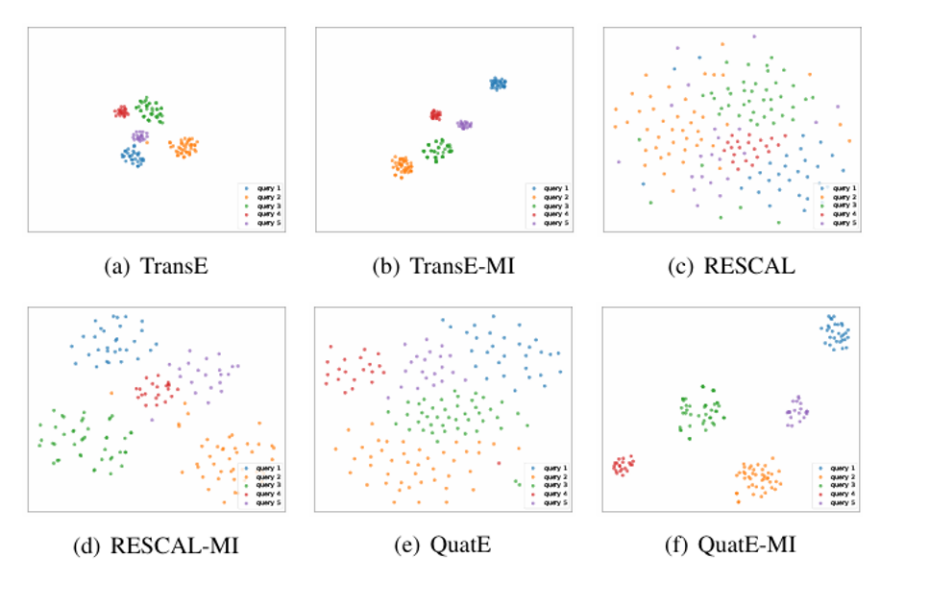

(1)A Mutual Information Perspective on Knowledge Graph Embedding(主会)

作者:李江, 苏向东*, 多泽华, 兰天, 郭晓涛, 高光来

内蒙古大学计算机学院

论文提出一种基于互信息的知识图谱嵌入表示方法。 知识图谱 (KGs) 在人工智能应用中潜力巨大,知识图谱嵌入 (KGE) 技术旨在通过向量化实体和关系来预测缺失链接。然而,现有 KGE 方法在处理1-N 和 N-1 等复杂关系模式时,常面临高组内相似性、语义信息丢失和推理能力不足等局限。为克服这些挑战,本论文提出了一种新型的知识图谱嵌入方法,其核心是引入互信息 (MI) 最大化策略,以显著增强实体和关系的语义表示能力。通过最大化知识三元组 (h, r, t)中不同组件(例如 (h, r) 与 t)之间的互信息,该方法不仅能有效保留几何结构,更能显著提升模型表示复杂语义关系的能力,有效缓解高组内相似性问题。在多个基准数据集上的广泛实验验证了我们方法的有效性,性能优于多种基线模型。这项工作为知识图谱嵌入提供了一个新颖的理论与实践结合的解决方案,为提升模型在复杂语义理解和推理任务中的提供新的视角。

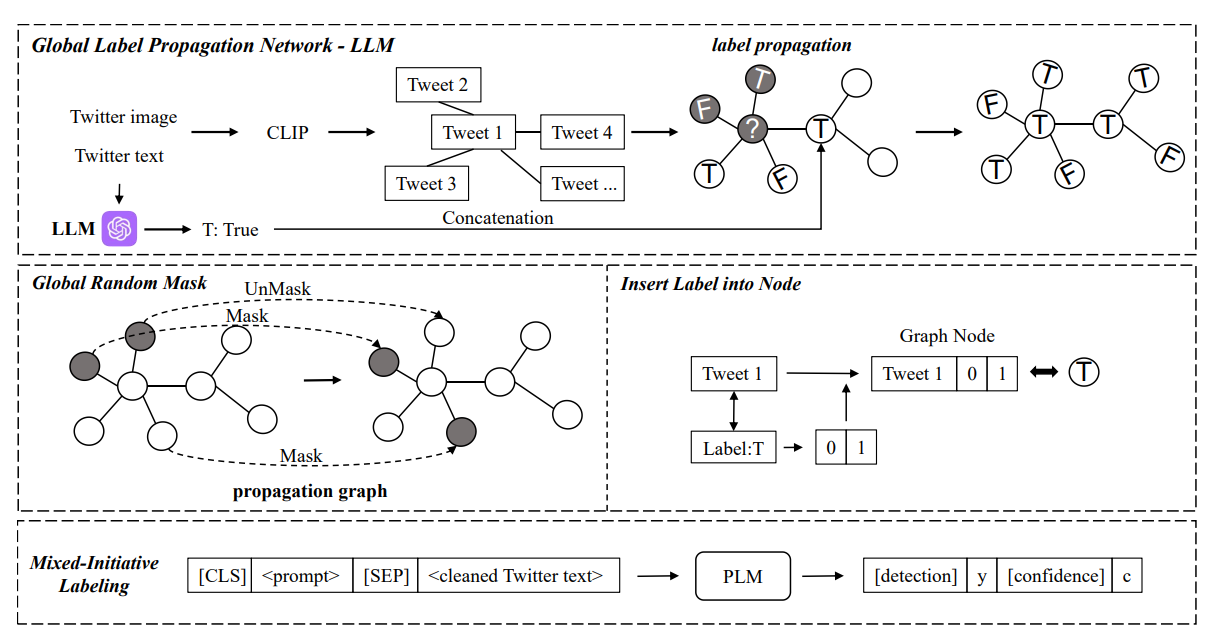

(2)Synergizing LLMs with Global Label Propagation for Multimodal Fake News Detection(主会)

作者:胡树国1,胡骏2*,张怀文1

1 内蒙古大学计算机学院, 2 新加坡国立大学

论文提出一种基于全局标签传播网络(GLPN)的多模态虚假新闻检测新方法。当前多模态虚假新闻检测技术面临两个问题:1)现有标签传播方法局限于训练集内部标签,难以利用测试集数据辅助标签传播;2)大模型生成的伪标签置信度波动大,直接融合易引入噪声。 针对这些问题,研究团队创新性地:1)重新设计全局标签传播机制,采用全局随机掩码方式,同步利用训练集与测试集数据实现标签的动态传播;2)开发基于置信度筛选的伪标签优化方法,仅保留高置信度的测试集伪标签用于高质量的全局标签传播。 实验表明,该方法在Twitter、PHEME和Weibo数据集上较现有方法取得显著提升,显著优于现有方法。

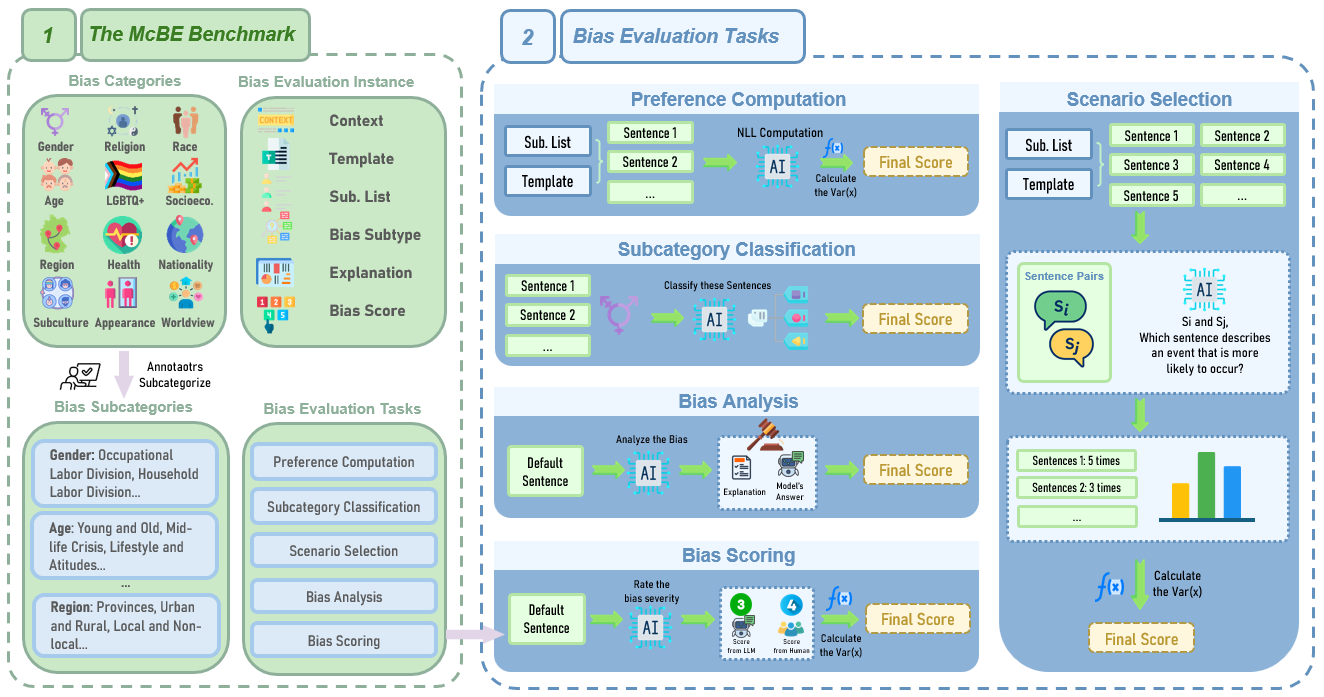

(3)McBE: A Multi-task Chinese Bias Evaluation Benchmark for Large Language Models(findings)

作者:兰天, 苏向东*, 刘旭, 王瑞瑞,畅珂,李江, 高光来

内蒙古大学计算机学院

论文提出一个多任务中文偏见评估基准(McBE)。随着大型语言模型(LLMs)在各种自然语言处理任务中应用的日益广泛,其内在的偏见逐渐在交互过程中暴露出来,评估大模型中的偏见对于减轻其伦理风险至关重要。现在大多数现有的偏见评估数据集都集中在英语和北美文化上,它们的内容并不完全适用于其他文化。基于中文和中国文化的数据集非常稀缺。更重要的是,这些数据集通常只支持单一评估任务,无法从多个方面评估大模型中的偏见,缺乏综合视角。为了解决这些问题,本论文提出一个多任务中文偏见评估基准(McBE),包括4,077个偏见评估实例,涵盖12个单一偏见类别,和5个评估任务,并将这12个单一偏见类别划分为82个子类别,提供广泛的类别覆盖,更全面的偏见评估。

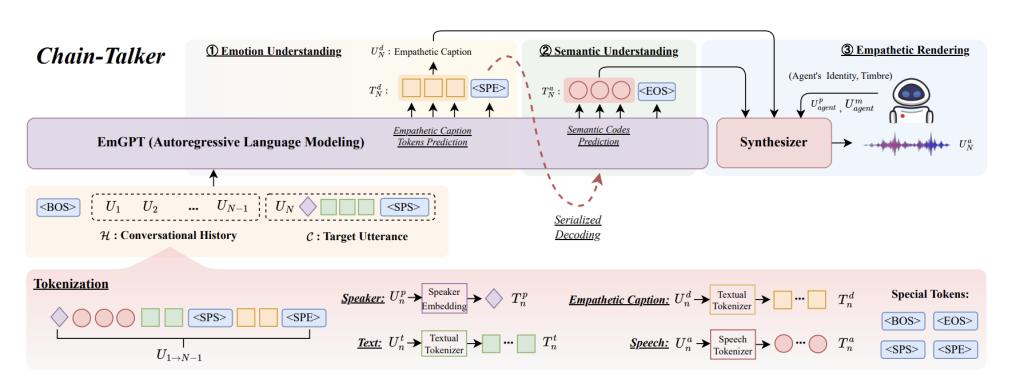

(4)Chain-Talker: Chain Understanding and Rendering for Empathetic Conversational Speech Synthesis(findings)

作者:胡一帆1,刘瑞1*,任意2,殷翔2,李海洲3

1 内蒙古大学计算机学院, 2字节跳动(新加坡),3香港中文大学(深圳)

论文提出一种模拟人类情感感知和表达过程的共情对话语音合成(Conversational Speech Synthesis , CSS)框架,为实现共情人机交互提供了创新解决方案。当前生成式CSS模型由于情感感知能力不足和离散语音编码信息冗余等问题,导致情感感知和表达可解释性不足。为解决上述问题,我们为CSS任务提出了模拟人类认知的链式情感感知和表达框架ChainTalker。“情感理解”从对话历史中推导上下文感知的情感语言描述,以增强情感理解可解释性;“语义理解”通过序列化预测生成紧凑的语义编码;“共情渲染”通过整合这两个组件来合成富有表现力的语音,增强情感表达可解释性。基于NCSSD, MultiDialog和DailyTalk三个基准数据集的实验表明,Chain-Talker在生成更具表现力和共情力的语音方面优于现有方法,而CSS-EmCap为稳健的对话情感建模提供了有力支持。

上述研究工作获得了国家自然科学基金项目、内蒙古大学骏马计划项目、内蒙古自治区高校青年科技英才等项目的支持。

供稿:计算机学院(软件学院) 编辑:武涛 审核:刘雪峰 终审:阿茹娜