近日,我校蒙古文智能信息处理技术国家地方联合工程研究中心、内蒙古自治区多语种人工智能技术重点实验室飞龙、王炜华课题组在蒙古文大语言模型、持续命名实体识别等方面取得重要进展,相关论文“TM-Bench: Benchmarking Large Language Models on Low-Resource Traditional Mongolian”、“Selective Distillation for Continual Named Entity Recognition with Memory Replay”被SIGIR 2026(International ACM SIGIR Conference on Research and Development in Information Retrieval)会议录用。SIGIR是信息检索领域公认的国际顶级会议,是中国计算机学会(CCF)推荐的A类会议,也是国际计算机学科排名CSRankings列表会议。

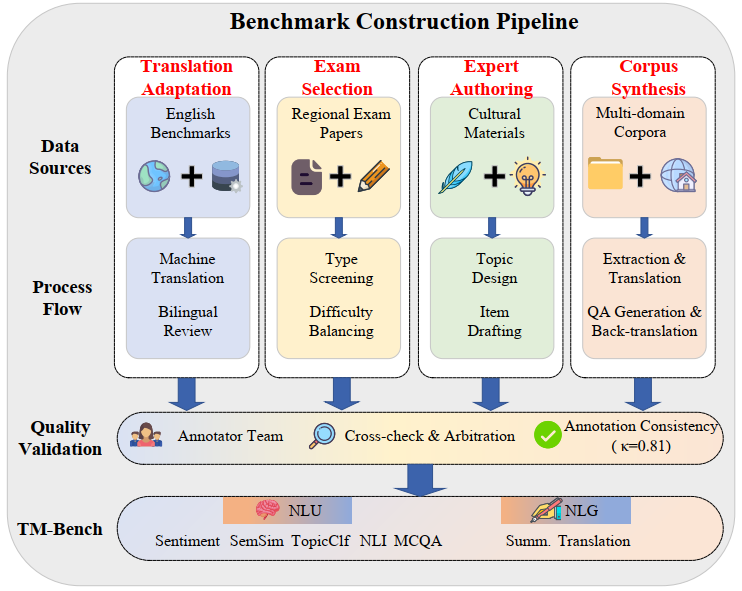

论文题目:TM-Bench: Benchmarking Large Language Models on Low-Resource Traditional Mongolian(Resource长文)

作者:郜振杰、飞龙*、阿如汗、侯瑞辰、吉谐琦、达布力干、呼格吉乐、李源

单位:内蒙古大学

论文简介:大语言模型在高资源语言中取得了显著的成功,但其在传统蒙古文上的表现仍然非常有限。当前的主要瓶颈在于缺乏系统性的评测框架,这不仅阻碍了模型间的定量比较,也使得后续的模型优化缺乏明确指引。在本文中,我们提出了TM-Bench,这是首个针对大语言模型传统蒙古文能力的综合评测基准。TM-Bench采用混合构建策略,融合了翻译改编、专家原创编写以及半自动合成技术。该基准涵盖自然语言理解和生成领域五项任务的18,357个数据实例,以全面评估模型的推理、知识应用和语言熟练度。我们在多种具有代表性的模型上进行了系统性评估。结果表明,在理解任务上,大多数面向高资源语言的大语言模型性能下降明显,仅有少数模型略高于随机猜测基线。对于生成任务,无论是自动评测指标还是双盲人工评测,都揭示了现有模型存在严重的语义崩溃现象——无法生成连贯的文本,且频繁生成不可读的乱码。这些发现不仅突显了TM-Bench在评测大语言模型在传统蒙古文能力方面的价值,也为未来大语言模型的定向优化指明了方向。

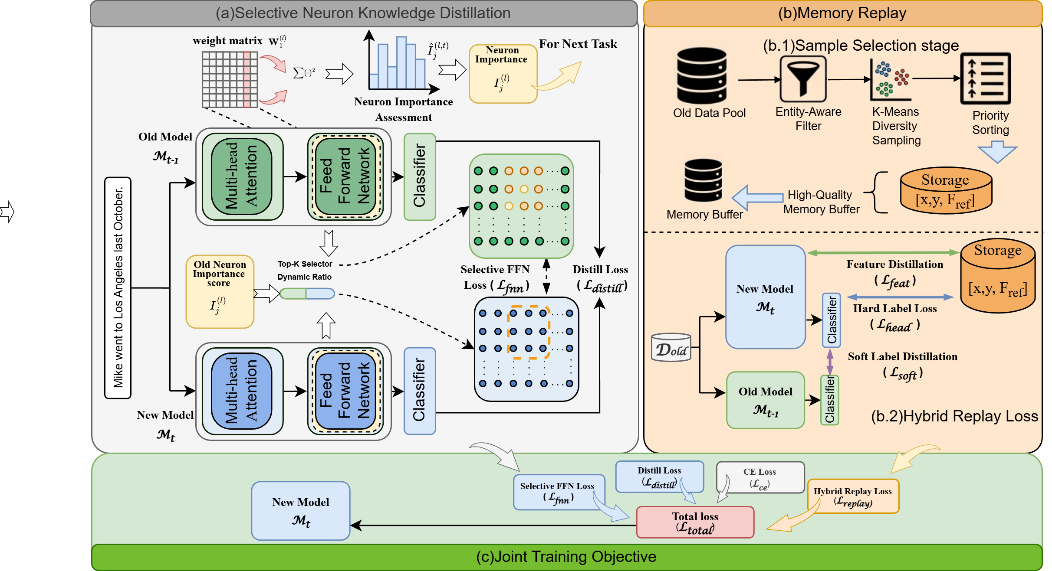

论文题目:Selective Distillation for Continual Named Entity Recognition with Memory Replay(Research短文)

作者:王炜华、曹越、飞龙

单位:内蒙古大学

论文简介:持续命名实体识别旨在让模型能够逐步学习新的实体类型,同时避免遗忘先前学到的知识。现有方法往往忽视实体类别的不平衡问题,在面对稀有的或新类别时,性能衰减严重。为解决这一问题,我们提出了一种知识蒸馏框架,该框架通过选择性知识蒸馏与记忆回放来抵御遗忘。具体而言,我们提出一种基于梯度的实体知识重要性评估方法,并结合新旧任务的标签比例动态调整蒸馏损失。此外,我们还构建了一个包含多实体类型及其特征的记忆缓冲区,并设计了适配缓冲区的采样策略。本文在多个持续命名实体识别基准数据集上验证了提出方法的有效性,实验结果表明,我们的方法优于最新持续命名实体识别基线,并在持续学习新实体过程中最大程度克服了遗忘,并在识别新类时表现地更加稳定。

供稿:计算机学院(软件学院) 编辑:武涛 审核:李文娟 终审:阿茹娜